L’Intelligenza Artificiale permea sempre più le nostre società. Come ha riportato nel 2019 uno studio della Gartner – società esperta di consulenza e ricerca in ambito tecnologico -, nel mondo circa il 37% delle aziende, a oggi, sfrutta sistemi di Intelligenza Artificiale, contro il 25% nel 2018.

L’AI si fa strada anche in Italia e il mercato – tra software, hardware e servizi – nel 2019 ha raggiunto il valore di 200 milioni di euro, di cui il 78% commissionato da imprese italiane e il 22% come export, come emerge da un’indagine dell’Osservatorio Artificial Intelligence della School of Management del Politecnico di Milano. L’AI è diffusa in particolare in banche e finanza (25% del mercato), nella manifattura (13%), nelle utility (13%) e assicurazioni (12%). La quota principale della spesa (il 33%) è dedicata a progetti di Intelligent Data Processing, algoritmi per analizzare ed estrarre informazioni dai dati.

Queste tecnologie fanno parte della nostra vita quotidiana, in modo non sempre evidente come in Giappone, dove robot già sostituiscono gli umani in diversi impieghi. Infatti, come emerso in un sondaggio del 2016, il 22% delle persone associa l’“Intelligenza Artificiale” alla sola “robotica”; ma quest’ultima è soltanto una branca fra le molte che danno corpo alle intelligenze artificiali.

Androide dotato di intelligenza artificiale in un centro commerciale a Tokyo.

Cos’è l’intelligenza artificiale?

Una delle definizioni più accettate di AI è quella di Nils J. Nilsson, secondo cui rendere le macchine intelligenti significa far sì che queste entità possano “funzionare opportunamente e con previsione nel proprio ambiente”. In altre parole, se poste di fronte a un problema devono riuscire a risolverlo. In effetti, la prima forma di AI fu la Pascalina, antesignana della calcolatrice: in grado solo di sommare e sottrarre, venne inventata nel 1642.

Eppure, ormai, non riteniamo più “intelligente” una calcolatrice. Questo è dovuto all’“effetto AI”, o “odd paradox”: le AI non sono più considerate tali quando si diffondono, come se l’abituarsi a esse le rendesse obsolete. D’altronde è un campo in continuo sviluppo, soprattutto a partire dalla nascita del deep learning, la capacità di elaborare gli errori per correggere i propri modelli, caratteristica delle reti neurali artificiali. Costruite a imitazione dei sistemi nervosi biologici, infatti, esse sono costituite da elementi processuali fortemente interconnessi, in grado di confrontare grandi moli di informazioni. Ad esempio, risultati attesi e osservati: in questo modo possono migliorare le proprie performance e apprendere a partire da esempi. È grazie a questo meccanismo che l’assistente virtuale di Google ha raggiunto il punteggio di un bambino di sei anni in un test di quoziente intellettivo nel 2016.

Però questi algoritmi necessitano ancora del contributo umano quando si trattano i big data, ovvero le grandi moli di dati che si producono con internet – che raddoppiano ogni anno. Nel crowdsourcing si sfrutta l’azione di volontari per allenare algoritmi che gestiscano i big data; il più celebre esempio di quanto ne risulta è Wikipedia, i cui collaboratori sono migliaia, consentendone grande ricchezza.

L’intelligenza artificiale e l’istruzione

Anche altri siti per l’apprendimento sfruttano AI: le piattaforme di tutoraggio online possono fornire conoscenza personalizzata; vi sono chatbot che forniscono automaticamente risposte a domande; e applicazioni che riescono nel difficile compito del natural language processing (comprensione del linguaggio umano con tutti i suoi possibili difetti) per correggere gli errori del parlato. Come nel caso di Duolingo, applicazione per l’apprendimento delle lingue.

Non a caso le AI vengono sfruttate anche nelle scuole. Oggi sono decine i robot usati nell’ambito educativo: alcuni (denominati Intelligent Tutoring Systems) possono apprendere lezioni da insegnare, fornendo esempi e risposte specifiche a seconda delle situazioni; altri fungono da sistemi per dimostrare certi fenomeni, come nel caso di PLEO rb, sul quale è possibile sperimentare gli effetti di diversi ambienti (molto utile nei corsi di biologia). Anche per le valutazioni le AI sono già ampiamente utilizzate: nei test a risposta multipla e nella verifica dei plagi, entrambi sistemi di cui usufruisce, ad esempio, l’Università di Torino.

L’intelligenza artificiale nella sanità

Altro campo dove le AI hanno trovato terreno fertile è la sanità. Già da anni le AI sono sfruttate per indagare possibili rischi per la salute, via app per telefonini e dispositivi per il monitoraggio dei pazienti; negli ospedali, sistemi intelligenti incrociano i dati dei ricoverati, a beneficio dei medici.

Molte le novità: nel febbraio 2019 il progetto europeo DeTOP ha consentito l’impianto, per la prima volta permanente, di una mano robotica, controllabile in modo naturale e capace di fornire informazioni tattili alla proprietaria; lo stesso anno l’organizzazione non-profit per la pratica e ricerca medica Mayo Clinic ha prodotto con successo una tecnologia in grado di prevenire l’insorgere di un infarto, grazie alla fusione di AI ed elettrocardiogramma.

Da qualche anno alcune AI affiancano persino i dottori: nelle diagnosi, come le reti neurali che individuano anomalie nelle radiografie o tumori della pelle (come emerge in un articolo di Nature del 2017), o in sala operatoria, come nel caso delle AI che guidano gli interventi di chirurgia plastica. Le AI sono state proposte per effettuare il dosaggio personalizzato dei medicinali e potrebbero persino ideare medicine nuove analizzando le composizioni di quelle già esistenti.

Robot in parte antropomorfi sono stati usati in Italia e all’estero per ridurre i rischi di contagio ed effettuare monitoraggio e assistenza dei pazienti ricoverati nei reparti intensivi per la pandemia da COVID-19.

L’intelligenza artificiale può aiutarci a monitorare la salute tramite app e smartwatch.

Intelligenza artificiale e sicurezza

Anche nel settore della sicurezza le AI affiancano l’uomo da lungo tempo. Nei social media, sistemi intelligenti di analisi di big data possono aiutare a individuare nuclei terroristici o altri gruppi violenti e fake news (problema indicato nel 2018 fra i maggiori rischi globali dal World Economic Forum). Altri algoritmi sono allenati a individuare possibili criminali in luoghi pubblici o denunce false, attraverso il rilevamento di comportamenti o frasi sospette, con risultati più accurati di quelli umani. Quanto al riconoscimento facciale, il suo uso è limitato in molti paesi dalle leggi sulla privacy; nelle strade viene invece fatto uso di sensori in combinazione con le videocamere, allo scopo di migliorare i servizi stradali oltre che di ricostruire a posteriori dinamiche di incidenti.

Applicazioni e mappe intelligenti, che consentono ai guidatori di orientarsi, sfruttano da oltre un decennio tali informazioni su strade e traffico. E da anni sono in commercio le auto automatiche e semiautomatiche, che sfruttano deep learning per apprendere tragitti e decine di sensori che consentono loro di evitare ostacoli imprevedibili.

Intelligenza artificiale nella vita privata

Ma possiamo venire a contatto con AI anche nelle nostre dimore. Le case stesse possono essere intelligenti: la domotica può aiutare la gestione domestica a distanza, programmando l’azione degli elettrodomestici e monitorando l’attività umana per predirne le necessità.

Poi, naturalmente, le incontriamo su internet: le chat di supporto ai clienti sono generalmente automatizzate, in grado di interpretare le domande e rispondere coerentemente, come anche gli assistenti virtuali, usati nel 20% delle ricerche su Internet. Applicazioni social e di acquisti, come Amazon, sono in grado di tracciare le preferenze degli utenti per anticipare di quali prodotti potrebbero aver bisogno, in un meccanismo denominato “profilazione degli utenti”, molto discusso perché ritenuto lesivo della privacy.

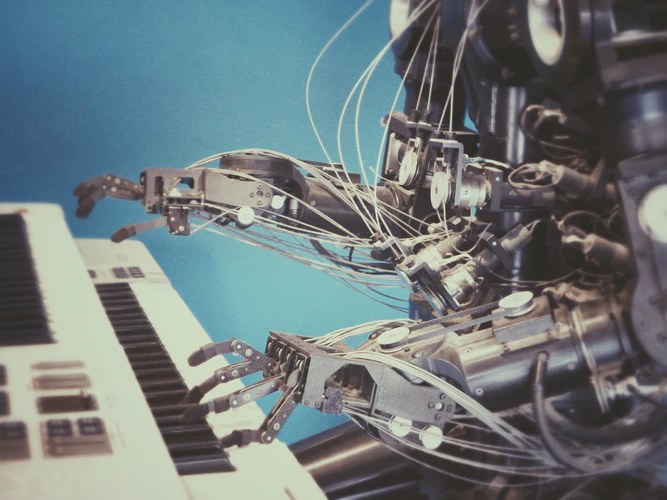

Nei videogiochi, la risposta del nemico a date azioni del giocatore è frutto di algoritmi intelligenti. Inoltre, AI sono in grado di analizzare e produrre quadri e musica, di valutare il successo di un film prima ancora che venga girato, nonché di scrivere semplici articoli di giornale e addirittura di presentare notizie al telegiornale.

Alcune intelligenze artificiali sono in grado di comporre musica e suonare.

I rischi dell’intelligenza artificiale

Ma non è tutto oro quello che luccica. Le AI potrebbero essere la causa della Terza Guerra Mondiale.

Lo ha twittato nel 2017 Elon Reeve Musk, imprenditore e inventore. Un timore che altri personaggi definiscono ingiustificato, ma che oltre cinquecento esperti hanno condiviso, fra cui Stephen Hawking, firmatari di due lettere aperte contro l’uso incontrollato delle intelligenze artificiali.

Perché mai le AI, così utili, dovrebbero farci paura? Il problema nasce nel momento in cui viene loro data una possibilità di scelta in posizioni critiche. Una questione spinosa per due motivi: innanzitutto, noi non possiamo prevedere le azioni di una AI, semplicemente perché non penserà mai come un essere umano. Sebbene basata sull’uomo, si tratterebbe sempre di un’entità diversa. In secondo luogo, chi sarebbe il responsabile delle conseguenze? Chi le costruisce, chi le usa, o chi altro? Aspetto essenziale, poiché la deresponsabilizzazione rende meno attenti i controlli e più propense le persone a usare queste tecnologie in modo improprio.

Incidenti di percorso

Già diversi robot hanno ucciso, perché programmati a farlo ma anche per errori software e situazioni non previste dai progettisti. Più di trenta i paesi (fra cui USA e Italia) dove già si usano droni e sentinelle armati: “possono essere armi di terrore, armi che i despoti e terroristi userebbero contro popolazioni innocenti, e armi hackerate […]. Una volta che il vaso di Pandora sarà stato aperto, sarà difficile da chiudere” sono le parole rivolte alle Nazioni Unite dalla lettera del 2017 contro gli armamenti intelligenti.

Altro problema etico è legato alla privacy: come disporrebbero le AI dei dati personali? Il loro uso potrebbe incidere sulla democrazia? Gli algoritmi dei social network e dei motori di ricerca sono capaci di memorizzare le preferenze degli utenti per riproporre contenuti a loro graditi, rinforzandone così le opinioni – effetto conosciuto in psicologia come “echo chamber effect”.

Un risultato di questo si può osservare negli Stati Uniti, dove le idee dei sostenitori di Democratici e Repubblicani si radicalizzano sempre più. Polarizzazione che riduce il pensiero originale; nonché un potenziale modo per controllare le masse, laddove questi algoritmi siano manipolati dai governi, ad esempio attraverso il recente fenomeno del “big nudging”. Si tratta del “paternalismo attraverso i big data”, manipolazione delle informazioni per ridurre i comportamenti indesiderati da parte dei cittadini.

Inoltre, la diffusione delle AI inciderà sicuramente sull’occupazione, determinando la scomparsa di alcuni impieghi e creando posti di lavoro che richiederanno competenze del tutto nuove. Questi problemi sembrano distanti, ma non lo sono. In effetti, la psicologia conferma quanto sottostimiamo rischi con cui non abbiamo mai avuto a che vedere.

Quali sono le soluzioni?

Una soluzione sarebbe di conoscere a fondo le AI prima di renderle completamente autonome e ideare algoritmi che le rendano friendly, cioè in linea con quello che vorremmo facessero, assicurandosi che non possano cambiare le proprie motivazioni. Tuttavia, il rischio manipolazione le rende comunque pericolose.

“L’Intelligenza Artificiale ci aiuterà a risolvere problemi difficili e faciliterà la nostra vita. Dobbiamo però assicurarci che sia sviluppata e usata nel modo giusto, con la giusta considerazione del suo impatto sulle persone e sulla società.” Queste sono le parole della Presidentessa del Comitato Etico dell’Associazione per l’Avanzamento delle AI (AAAI), Francesca Rossi. Infatti, prosegue, è necessario “che non sia discriminatoria, che rispetti la privacy e la dignità delle persone, e che le sue decisioni siano giustificabili”. Aspetti importanti e complessi, che sottolineano quanto urga discutere delle AI.

Per approfondire

- https://www.osservatori.net

- Scientific American, 2017. Will Democracy Survive Big Data and Artificial Intelligence?

- Yudkowsky E., 2008. Cognitive Biases Potentially Affecting Judgment of Global Risk.

- Stone P., Brooks R. et al., 2016. “Artificial Intelligence and Life in 2030: One Hundred Year Study on Artificial Intelligence: Report of the 2015–2016 Study Panel”.

3 commenti

L’intelligenza artificiale contro la COVID-19 - AAC Srl · Settembre 3, 2021 alle 10:59 am

[…] i problemi etici e non solo che potrebbe comportare, l’intelligenza artificiale sembra costituire un’utile alleata […]

Arrestata Ai-Da, artista robot - AAC Srl · Ottobre 23, 2021 alle 6:09 pm

[…] anche: Intelligenza artificiale e società: dalle aziende alle case L'intelligenza artificiale contro la […]

Tornare a camminare grazie alla bioingegneria - AAC Srl · Luglio 28, 2022 alle 12:20 am

[…] l’integrazione tecnologica dell’Intelligenza Artificiale (AI) e dell’apprendimento automatico nell’industria protesica e nel campo delle […]